Ankündigung

Einklappen

Keine Ankündigung bisher.

KI liefert beste Wettervorhersage

Einklappen

X

-

Vom wunderbaren "Wetterochs" (wettermail.de) der neben einer lokalen Wettervorhersage für meine Region immer wieder interessante, amüsante, bemerkenswerte Exkurse in seine Mails einbaut. Hier zwei Erklärbär-Anhänge zu KI und klassischen Wettermodellen:

Wettermail vom 18.11:

P.S.: Es ging ja in letzter Zeit durch viele Medien und Zuschriften habe ich auch schon eine Menge zu dem Thema erhalten: Die KI (künstliche Intelligenz) macht Wettervorhersagen! Konkret macht GraphCast von Google DeepMind Wettervorhersagen. Die Meldungen sind überschwänglich, angeblich wurde sogar das beste konventionelle Wettermodell, das des ECMWF geschlagen. Haben die Journalisten da wieder mal etwas falsch verstanden? So ähnlich wie beim Gardasee, wo fälschlicherweise angenommen wurde, dass der See bei einem Pegelstand von 0 komplett ausgetrocknet wäre?

Ich habe die GraphCast-Prognosekarten auf meiner Seite unter Wetterkarten/Karten verlinkt, welche vom ECMWF angeboten werden. Und da wurde ich schon hellhörig, denn das ehrwürdige ECMWF ist selbst mit im Boot. Und wenn man nun die GraphCast-Ergebnisse mit der realen Wetterentwicklung und den Ergebnissen des konventionellen Wettermodells vergleicht, dann muss man das einfach als Sensation bezeichnen, denn aus meiner Sicht sind die Ergebnisse beider Verfahren gleichwertig.

Und da kommt noch dazu, dass die Erstellung einer GraphCast-Prognose nur einen winzigen Bruchteil der Rechenleistung konventioneller Modelle benötigt (weniger als 1 %). Ich weiß gar nicht mehr, wie ich das noch nennen soll, Sensation im Quadrat vielleicht. Man denke nur, was da jetzt alles möglich ist: Blitzschnell tausende von Ensemble-Berechnungen (leicht variierte Eingangsdaten) durchführen, quasi kontinuierlich neue Modellberechnungen bei sommerlichen Gewitterlagen und vieles mehr.

Vielleicht kann ich mich ja wieder beruhigen, indem ich über die Sache wie ein vernünftiger Mensch nachdenke. Dass GraphCast eine Wettervorhersage blitzschnell berechnen kann, ist ja nur die eine Seite der Medaille. Auf der anderen Seite geht bei der KI eine wochenlange äußerst rechenintensive Trainingsphase voraus, in der das Modell mit historischen Wetterdaten gefüttert wird.

Aber Moment, dieses Prinzip kennen wir doch alle aus der Grundschule. Hans hat keine Lust das Einmaleins auswendig zu lernen und muss sich jedes Mal das Ergebnis durch mehrere Additionen herleiten. Da sagt die Lehrerin "Hans, wie viel ist 3 mal 7?" und der antwortet "Ah, das ist 7 + 7 ist gleich 14 und 14 + 7 ist gleich 21". Da entgegnet die Lehrerin: "Das Ergebnis ist richtig, aber du hättest das auswendig lernen sollen!" Dann wendet sie sich zu einem anderen Schüler: "Sag mal Max, wie viel ist denn 3 mal 8". Von dem kommt dann ein "24!" wie aus der Pistole geschossen. "Und lieber Max, Du weißt doch sicher auch, wie man zu diesem Ergebnis durch Addition gelangt?" Da wird dieser aber verlegen und läuft rot an und gibt widerwillig zu, dass er überhaupt nicht weiß, was eine Addition ist, er hat nur die Einmaleins-Tabelle im Schulheft auswendig gelernt ohne zu verstehen, wie die Zahlen dort zustande kommen und was sie bedeuten.

Und das ist der Unterschied zwischen den konventionellen Wettermodellen und der künstlichen Intelligenz. Die konventionellen Wettermodelle arbeiten wie Hans, sie rechnen sich immer wieder dieselben Sachen von Grund auf neu aus. Die KI arbeitet wie Max, sie merkt sich eine große Anzahl von Wetterzusammenhängen anhand von Beispielen (historischen Wetterdaten), ohne jedoch die mathematisch-physikalischen Hintergründe zu verstehen. Hans kann sofort loslegen, arbeitet dann aber aufwändig und langsam. Max braucht erst Zeit zum Lernen, ist dann aber schnell in der Ausführung. Nur reden wir bei der KI von ganz anderen Dimensionen. Da reden wir von 6955558 mal 95247555 und Hans rechnet das aus, während Max das Ergebnis 662499893160690 auswendig weiß.

Ich denke da aber auch an mein selbst erstelltes Radarbild. Die Daten des Radar-Komposits vom Deutschen Wetterdienst kommen in einem 1x1 km Raster, konkret in Form von 1200 x 1100 = 1320000 ganzzahligen Intensitätswerten / Dezibelwerten, die von 0 bis 4095 reichen. Nun hat mein Programm in einem ersten Ansatz für jeden Bildpunkt einzeln die Zuordnung Dezibelwert -> Farbe des Pixels im Radarbild durchgeführt (z.B. gelb für einen geringen, lila für einen hohen Dezibelwert). Also 1320000-mal im Programm einen Dezibelwert in eine Farbe umgerechnet. Aber Moment, es gibt ja nur 4096 Dezibelwerte, die 7 verschiedenen Farben zugeordnet sind, also nur 28.672 mögliche Zuordnungen. D.h. bei diesen 1320000 Farb-Bestimmungen kommen sehr viele Wiederholungen vor und das Programm hat sich eben nur nicht gemerkt, dass es den Farbwert für diesen Dezibelwert schon einmal berechnet hat. Die Lösung ist natürlich, alle 28.672 möglichen Zuordnungen Dezibelwert -> Farbe vorher zu bestimmen und in einer sogenannten Lookup-Tabelle abzulegen, also sozusagen wie Max alles vorher auswendig zu lernen. Und das hat dann die Erstellung meines Radarbildes um den Faktor drei beschleunigt.

Wettermail vom 19.11.

P.S.: Zu meinen gestrigen Ausführungen bezüglich KI in der Wettervorhersage habe ich einige Zuschriften erhalten. Und ich habe gemerkt, dass es bei diesem Thema ein Missverständnis gibt, auf das ich - ehrlicherweise zugegeben - auch schon hereingefallen bin. Das Missverständnis ist, dass dieses KI-Verfahren sozusagen ein gigantischer Bauernkalender ist, eine riesige Menge an Bauernregeln. Dass man sich so etwas wie 10000 verschiedene Wetterlagen gemerkt hat, dann passend zur aktuellen Lage eine von diesen 10000 Wetterlagen heraussucht und davon ausgeht, dass sich alles genau so wiederholen wird wie damals. Und dass der Bauernkalender im Prinzip schon der richtige Ansatz war, der damals eben nur an der zu geringen Datenmenge gescheitert ist.

Aber so ist das nicht. Der Bauernkalender-Ansatz bringt einfach nichts. Der fundamentale Fehler dabei ist, dass der Übergang vom Speziellen zum Allgemeinen fehlt. Die Einzelfälle bleiben Einzelfälle, es werden daraus keine übergeordneten Erkenntnisse gewonnen. Es gibt eben nicht nur 10000 verschiedene Wetterlagen. Ein globaler Wetter-Datensatz mit niedriger Auflösung besteht aus ca. einer Milliarde Zahlen. Da kann man sich vorstellen, dass die Anzahl der möglichen Variationen dieser Zahlen, also die Anzahl möglicher Wetterlagen, so gigantisch ist, dass sie jegliche Vorstellungskraft sprengt. Und wie wir von den Ensemble-Berechnungen wissen, führen schon winzige Variationen über einen Zeitraum von einer Woche zu einem völlig anderen Ergebnis.

Die KI schaut sich vergangene Wetterlagen an und vergleicht die Wetterlage zu einem bestimmten Zeitpunkt mit der darauffolgenden Wetterlage sechs Stunden später. Und daraus gewinnt sie die Regeln, wie sich Wetterlagen innerhalb dieser Zeitspanne von sechs Stunden verändern. Das entspricht der iterativen Vorgehensweise eines normalen Wettermodells, nur wird die bisher übliche Menge an mathematischen Formeln und numerischen Berechnungen durch ein neuronales Netzwerk ersetzt. Obwohl man ja bei einem traditionellen Modell auch nie so recht weiß, wie viele Erfahrungswerte da verkleidet als physikalische Formeln Eingang gefunden haben.

Im alltäglichen Gebrauch ist die KI-Variante GraphCast letztlich nichts anderes als ein weiteres Wettermodell, das sich von der Analyse der realen Wetterlage ausgehend in 6-Stunden-Schritten in die Zukunft vortastet. Auch bei GraphCast werden die Prognosen mit fortschreitender Zeit immer unsicherer, auch dort liegt die Obergrenze für sinnvolle Prognosen bei rund zehn Tagen. Die eigentliche Revolution ist die hohe Geschwindigkeit (über 100-mal schneller als konventionell), mit der diese Prognosen erstellt werden.

- Likes 5

Einen Kommentar schreiben:

-

Hier noch, was Google dazu schreibt:

Our state-of-the-art model delivers 10-day weather predictions at unprecedented accuracy in under one minute

...und zurück zum Topic:

Stephanie Westerhuis erklärt hier bei Luzian (danke einmal mehr!!) etwas mehr über Meteo-Modelle. ML kommt glaub' ich nicht vor, aber sie erwähnt die notwendigen Anpassungen/Interpretationen durch MeteoSchweiz, um kleinräumig Verhersagen zu machen, die sich den realen Verhältnisse annähern. Ob es am Hausberg und in der Region trägt, hängt mehr vom Mikrowetter ab, das - zumindest bei uns in den Alpen - von Tal zu Tal völlig verschieden sein kann. Dafür nutzt man halt Webcams, Windstationen & die Erfahrung & nicht bloss eine ML-generierte Wetterkarte...

Einen Kommentar schreiben:

-

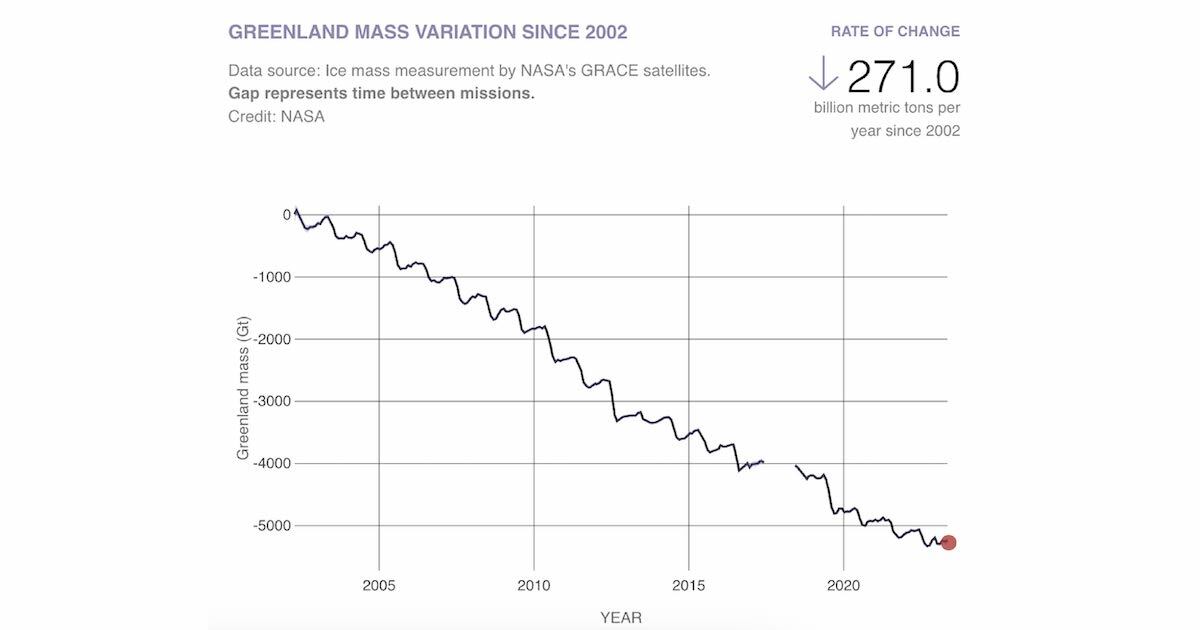

Wenn zitieren, dann bitte vollständig (Quelle):Zitat von MxNx Beitrag anzeigenStimmt, hast recht. Es waren die Wissenschaftler der NASA. Und dabei wächt die Eisfläche der Antarktis die letzten Jahre sogarWichtig ist zu unterscheiden, dass der Eisschild der Antarktis auf Grund des Klimawandels schmilzt, das Meereis dehnt sich aus. Die Eismasse nimmt insgesamt also auch am Südpol ab. Die Massenverluste beschleunigen sich sogar, bis zu 26 Gigatonnen/Jahr.

- Likes 4

Einen Kommentar schreiben:

-

Immer gut, wenn man sich selbst eine fundierte Meinung bilden kann...Zitat von MxNx Beitrag anzeigen

Stimmt, hast recht. Es waren die Wissenschaftler der NASA. Und dabei wächt die Eisfläche der Antarktis die letzten Jahre sogar

Vital Signs of the Planet: Global Climate Change and Global Warming. Current news and data streams about global warming and climate change from NASA.

Vital Signs of the Planet: Global Climate Change and Global Warming. Current news and data streams about global warming and climate change from NASA.

- Likes 1

Einen Kommentar schreiben:

-

Stimmt, hast recht. Es waren die Wissenschaftler der NASA. Und dabei wächt die Eisfläche der Antarktis die letzten Jahre sogarZitat von AffiPG Beitrag anzeigenErneut: Quelle? Kurze Recherche meinerseits ergab, dass das das Modell eines Wissenschaftlers ergeben, hat kein IPCC Report oder ähnliche Publikation die einem Konsens nahe kommt.

Der Artikel der BBC, der ursprünglich darüber berichtet hatte, erkennt das übrigens an:Zuletzt geändert von MxNx; 20.11.2023, 12:59.

Einen Kommentar schreiben:

-

Erneut: Quelle? Kurze Recherche meinerseits ergab, dass das das Modell eines Wissenschaftlers ergeben, hat kein IPCC Report oder ähnliche Publikation die einem Konsens nahe kommt.Zitat von MxNx Beitrag anzeigenlaut IPCC sollte s schon 2013 kein Eis mehr an den Polen geben. Die Wissenschaft kommt immer auf die Ergebnisse, die ihr Geldgeber erwartet

Der Artikel der BBC, der ursprünglich darüber berichtet hatte, erkennt das übrigens an:

Professor Maslowski's group, which includes co-workers at Nasa and the Institute of Oceanology, Polish Academy of Sciences (PAS), is well known for producing modelled dates that are in advance of other teams.

These other teams have variously produced dates for an open summer ocean that, broadly speaking, go out from about 2040 to 2100.

- Likes 1

Einen Kommentar schreiben:

-

SoaringErnie Intelligenz - egal ob natürliche oder künstliche - bedeutet nicht zwangsläufig ein einheitliches Wertesystem. Wenn sich also eine KI gegen Gleitschirmflieger oder auch nur für eine heilere Welt entscheiden würde, ist das kein Indiz für deren "Echtheit", sondern bestenfalls eines dafür, dass ihr entsprechende Parameter vorgegeben worden sind und ihre Entscheidungsfindung zufällig mit der einer fiktiven Person mit gleicher Zielsetzung übereinstimmt. Natürlich halten viele genau das, also dass jemand zu den gleichen Schlüssen wie sie selber kommt, für den Beweis von dessen "echter" Intelligenz

Das Problem bei DL ist das Spannungsfeld zwischen Transparenz und Effizienz. Opake KI behält ihre "Algorithmen" - genau genommen die Organisation der abstrakten Teilverarbeitungsschritte für eine große Datenmenge - für sich. Man kann also gar nicht beurteilen, inwiefern diese "verbessert" sind - das ginge allenfalls hinterher, wenn man sie also erst mal munter prognostizieren lässt und später die Ergebnisse mit der Realität vergleicht. Das ist aber Empirik - und die kann so irreführend sein, wie sie aufgrund der intuitiven Akzeptanz verführerisch ist, weil sie keinen Unterschied zwischen Korrelation und Kausalität macht. Anders gesagt: Wenn eine opake KI zufällig in einem Gebiet mit hoher Storchenpopulation viele Geburten vorhersagt, weiß keiner, ob sie nun einen Zufallstreffer gelandet hat, geheimnisvolles Spezialwissen entwickelt hat oder schlicht an Ammenmärchen glaubt. Sie verrät es keinem, und niemand kann es aus ihren DL-Zwischenergebnissen herauslesen. Eine gesunde Skepsis, solchen Systemen Entscheidungen zu überlassen oder an deren Prognosen zu glauben, nur weil in beeindruckender Geschwindigkeit plausible Ergebnisse herauspurzeln, ist da durchaus angebracht und keineswegs unreflektierte Technikaversion irgendwelcher "alter Dackel".

Transparente KI hingegen offeriert Eingriffspunkte und erklärt Teile der von ihr gefundenen Entscheidungsgrundlagen. Das Problem dabei: Wenn sie sehr viele Daten verarbeitet und sehr viele Entscheidungslayer generiert (die keineswegs linear aufeinander aufbauen, das wäre eher sowas wie die Expertensysteme der ersten Stunde), stellt sie auch sehr viele "Algorithmenhäppchen" zur Diskussion. Die Manpower, das dann kompetent zu bewerten, kann durchaus teurer als der eingesparte Aufwand kommen. Wieder anders ausgedrückt: Wenn eine kompetente, transparente KI all ihre kritischen Zwischenschritte zum Absegnen vorlegt, kann das keiner sinnvoll anwenden. Sofern es überhaupt jemanden interessiert - das Problem kennt jeder, der mal versucht hat, einem nicht technikaffinen Menschen komplexe Technologie soweit zu erklären, dass derjenige zu einer kompetenten Entscheidung zugunsten seiner eigenen Interessen imstande wäre.

Mustererkennung ist unstrittigerweise eine Stärke von selbstlernender KI. Aus den erkannten Mustern hingegen belastbare Schlüsse zu ziehen, ist eine Kunst für sich - und genau deshalb ist allzu blauäugiges Vertrauen in KI-basierte Prognose- und Entscheidungssysteme zurzeit noch ganz schön gefährlich.

- Likes 1

Einen Kommentar schreiben:

-

laut IPCC sollte s schon 2013 kein Eis mehr an den Polen geben. Die Wissenschaft kommt immer auf die Ergebnisse, die ihr Geldgeber erwartetZitat von AffiPG Beitrag anzeigen

🧐️ Quellen? Ich bekomm gefühlt immer nur mit, dass nach oben korrigiert wird und wir aktuell ins offene Messer laufen. Der einzige Artikel den ich dazu (Korrektur nach unten) gefunden hab ist über zehn Jahre alt und "korrigiert" die Prognose für 2025 von 1,5°C auf 0,9°C, laut IPCC waren wir im März 2023 bei 1,1°C.

- Likes 3

Einen Kommentar schreiben:

-

Paraglideable nutzt schon länger KI für die Kombination von Wetterprognosen und historischen (Flug-)Daten

Da muss man erst mal klären, was KI wirklich ist.

Echte KI käme zweifelsohne zu der Erkenntnis, dass Meteomodelle für Gleitschirmflieger überflüssig sind, weil auch Gleitschirmflieger überflüssig sind.

In der Folge würde eine echte KI (wenn sie wirklich intelligent ist) feststellen, dass es der Welt ohne den Menschen besser ginge und daher alles unternehmen, diesen zu eleminieren.

Was aktuell unter KI gehandelt wird, sind verbesserte Algorithmen (z.B. DL), die aufgrund der Leistungsfähigkeit der heutigen Rechner neue Analysewege eröffnen.

Einen Kommentar schreiben:

-

Zitat von ESP2019 Beitrag anzeigenErwartbar(er) wäre, das die Modelle zumindest im Mittel richtig liegen, aber das tun sie nicht.

Das die Temperatur tendenziell nach oben geht ist offensichtlich, aber die Steigerung ist doch eher weniger als alle Modelle bisher prognostizierten.

Bin gespannt, ob die KI da besser liegen wird...

🧐️ Quellen? Ich bekomm gefühlt immer nur mit, dass nach oben korrigiert wird und wir aktuell ins offene Messer laufen. Der einzige Artikel den ich dazu (Korrektur nach unten) gefunden hab ist über zehn Jahre alt und "korrigiert" die Prognose für 2025 von 1,5°C auf 0,9°C, laut IPCC waren wir im März 2023 bei 1,1°C.

Einen Kommentar schreiben:

-

... wobei die Spannweite +-3 Grad ist. Von "genau" kann dabei gerade nicht gesprochen werden.Zitat von BIKEandFLY Beitrag anzeigenWo ist jetzt der diametrale Unterschied zwischen „Wettermodellen“ = Wilder Westen und „Klimamodellen“? Denn Klimamodelle rechnen ja schon auf 1,5° in 30 Jahren genau!

Besonders auffällig ist auch, dass alle Modelle sich immer in Richtung nach oben täuschen. Erwartbar(er) wäre, das die Modelle zumindest im Mittel richtig liegen, aber das tun sie nicht.

Das die Temperatur tendenziell nach oben geht ist offensichtlich, aber die Steigerung ist doch eher weniger als alle Modelle bisher prognostizierten.

Bin gespannt, ob die KI da besser liegen wird...

Einen Kommentar schreiben:

-

Wo ist jetzt der diametrale Unterschied zwischen „Wettermodellen“ = Wilder Westen und „Klimamodellen“? Denn Klimamodelle rechnen ja schon auf 1,5° in 30 Jahren genau!Zitat von bembem Beitrag anzeigenDeep Learning (DL) und Statistik sind verwandt. Deine Intuition der Statistik wird wohl stimmen. Soweit ich die Grundlagen der aktuellen Wettermodelle verstanden habe, ist das ein wilder Westen.

Einen Kommentar schreiben:

-

Deep Learning (DL) und Statistik sind verwandt. Deine Intuition der Statistik wird wohl stimmen. Soweit ich die Grundlagen der aktuellen Wettermodelle verstanden habe, ist das ein wilder Westen. Vieles wird angenähert und vieles kennt man auch nicht. Eine Formel zu kennen hilft dir auch nichts, wenn du den Eingangswert nicht bestimmen kannst. Deep Learning ist aktuell das mächtigste, was wir im Bereich Mustererkennung haben und genau das macht es auch: Es beantwortet, wo der (wahrscheinlichste) Verlauf des Wirbelsturms durchgeht, nicht warum er dort durch geht.

Meteorologen haben nicht Computer Science studiert und tun sich deshalb etwas schwer mit DL. Es löst aber eigentlich viele ihrer Probleme und es ist eine Frage der Zeit, bis wir dort die Brücken bauen können.

Paraglidable.com verwendet als Input GFS Daten, also Shit in - Shit out (Leider).

Was am Klimawandel sprunghaft sein soll, verstehe ich nicht. Sprunghaft ist z.B. El Nino.Zuletzt geändert von bembem; 17.11.2023, 15:02.

- Likes 3

Einen Kommentar schreiben:

-

Verständlich.. ich habe dir geschrieben! Danke für das Angebot!Zitat von shoulders Beitrag anzeigenIch könnte das tun, will mir aber nicht wieder aus irgendwelchen anonymen Ecken vorwerfen lassen, die Leser des Forums mit zu wortreichen Ergüssen, womöglich gar OT, zu überlasten - anders wird man der Fragestellung jedoch nicht gerecht, wenn man sich nicht auf ein verkürzendes Bullshit-Bingo einlassen mag. Und das unweigerlich folgende anonyme Gestichel gegen meine Arbeit habe ich auch satt.

Wenn Du mir allerdings eine PN mit verifizierbaren Realnamen schickst, kannst Du gerne einen Artikelauszug dazu bekommen.

Einen Kommentar schreiben:

Einen Kommentar schreiben: